Blog Lab

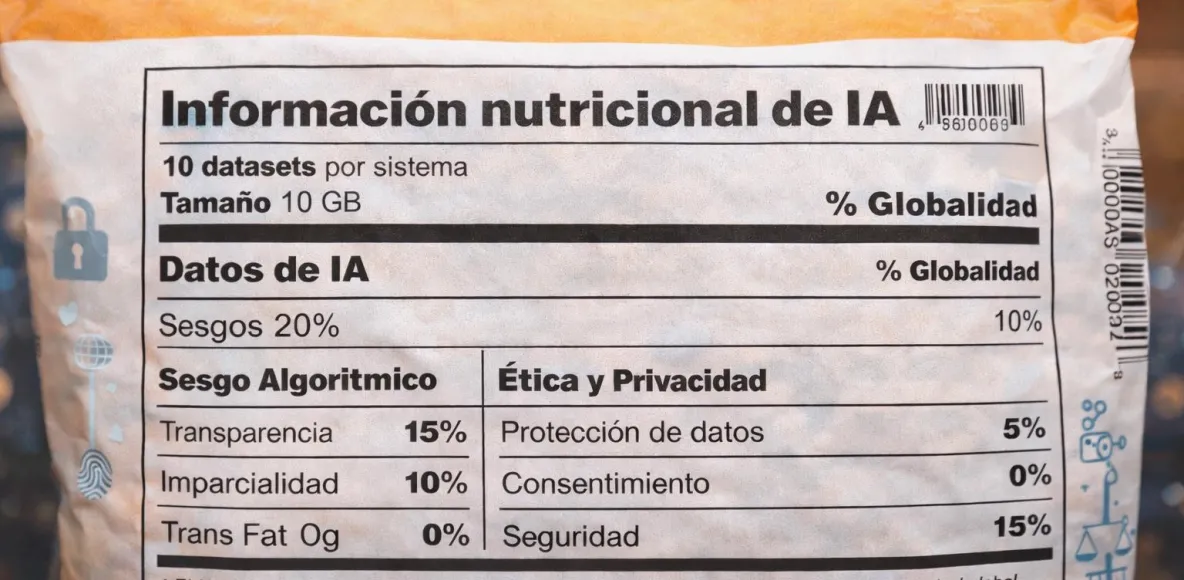

Información nutricional de la IA, ética en cada byte

Imagen generada con Inteligencia Artificial.

En Europa, los datos están fuertemente protegidos, mientras que China y otras regiones disfrutan de mayor libertad para entrenar sus sistemas de IA. Este artículo invita a reflexionar sobre cómo equilibrar ética y regulación global para que la innovación avance sin comprometer derechos fundamentales ni fomentar la “fuga de cerebros”.

Como buena veintañera entusiasta, disfruto de los cafés de especialidad. Todo transcurre con normalidad hasta que el barista pregunta:

—¿Qué leche quieres? ¿Avena, soja, sin lactosa?

—Normal, por favor.

—¿De vaca?

—Sí.

—¿Entera, semi o desnatada?

Más allá de lo anecdótico, la escena ilustra una realidad contemporánea: hemos aprendido a cuestionarnos qué consumimos, cómo se produce y qué implicaciones tiene cada elección.

En pleno siglo XXI, en un contexto en el que la alimentación consciente, la sostenibilidad y el consumo responsable ocupan un lugar central en el debate público, hemos interiorizado una máxima aparentemente sencilla: “Eres lo que comes”. Desde esa misma lógica, cabe plantear una pregunta que rara vez nos formulamos: ¿qué “comen” los sistemas de inteligencia artificial?

La respuesta es clara: datos.

La inteligencia artificial (en adelante, ‘IA’) ha dejado de ser una tecnología emergente para convertirse en un elemento estructural de nuestras sociedades. Con independencia de la generación a la que pertenezcamos, interactuamos con sistemas de IA de manera cotidiana, a menudo sin plena conciencia de los tratamientos de datos personales que ello implica. Precisamente por esa normalización, resulta imprescindible reflexionar no solo sobre las funcionalidades de la IA, sino sobre la calidad, legitimidad y ética de los datos que la alimentan.

Desde la óptica de la protección de datos, los datos no son un elemento neutro. Son el reflejo de contextos sociales, históricos y culturales concretos. Por ello, los sistemas de IA no generan sesgos de forma autónoma: los heredan de los datos con los que son entrenados y los reproducen, e incluso amplifican, a escala, con el riesgo añadido de conferirles una apariencia de objetividad tecnológica. Este fenómeno plantea desafíos relevantes en términos de equidad, no discriminación y garantía de los derechos fundamentales.

En este escenario, la ética en el envío de datos a sistemas de IA adquiere una relevancia central. El Reglamento (UE) 2024/1689 del Parlamento Europeo y del Consejo, por el que se establecen normas armonizadas en materia de inteligencia artificial (RIA), articula un enfoque basado en el riesgo y se apoya en principios que conectan directamente con la tradición europea de protección de derechos. La clasificación de sistemas prohibidos, de alto riesgo y de uso general evidencia una voluntad regulatoria clara: permitir el desarrollo tecnológico sin renunciar a un nivel elevado de protección de las personas.

Sin embargo, el debate no puede abordarse únicamente desde una perspectiva europeísta. ¿Responden otros modelos regulatorios, como los de Estados Unidos o China, a una lógica igualmente garantista? ¿Puede un marco normativo exigente actuar como freno a la innovación tecnológica? Lo cierto es que un desarrollador de sistemas de IA no tiene acceso al mismo volumen ni al mismo tipo de datos en Europa, Asia o Estados Unidos, y esa diferencia condiciona, de forma directa, dónde y cómo se diseñan y entrenan los sistemas de IA.

Para los profesionales del ámbito jurídico y tecnológico, este contexto plantea un reto significativo. La creciente complejidad normativa exige una actualización constante y una comprensión transversal de los impactos técnicos, jurídicos y sociales de la IA. Iniciativas como el denominado Digital Omnibus apuntan a la necesidad de revisar y ajustar los marcos existentes, pero el desafío de fondo permanece: cómo equilibrar innovación, competitividad y protección de los derechos fundamentales.

Aunque pueda parecer una aspiración ambiciosa, resulta necesario avanzar hacia ciertos estándares globales compartidos en el control y la calidad de los datos que se proporcionan a los sistemas de IA, de modo que se fomente el desarrollo tecnológico sin vaciar de contenido los valores que sustentan nuestro modelo de protección de derechos.

P. D. Este texto ha sido mejorado con la ayuda de un sistema de IA. Como no podía ser de otra manera.

Los contenidos, opiniones o comentarios publicados en este sitio web son responsabilidad exclusiva de sus autores y no reflejan ni sustituyen las comunicaciones oficiales, visión o directrices de la AEPD.